「強いAI」と呼ばれるAGI(汎用人工知能)とは?SFの世界に近づくAI技術と安全性確保への取り組みについて解説!

AI(人工知能)はその名の通り、人によって作られたものであり、それは人のような知能を持つことを目指して開発が進められてきました。

最近ではChatGPTがGPT-5を新たに公開したことで大きな話題となりました。ChatGPTを提供するOpenAI社CEOのサム・アルトマン氏は、2025年1月の自身のブログで、AIエージェントが人に代わる労働力になるかもしれないことを述べています。

参考(英語記事):https://blog.samaltman.com/reflections

人間のような言葉や動画をリアルに近い形で表すことができるにとどまっていたAIですが、ようやく、人間の代わりになることができるほどになってきたという実感があるようです。

それは、人間のように様々なタスクに対応できるAGI(汎用人工知能:Artificial general intelligence)というもので、年々注目されてきているAIです。また、人間の知能をはるかに超えたASI(人工超知能:Artificial Superintelligence)というAIの議論をさらに一歩前に進めるような言葉を聞くようになりました。しかし、いずれもまだどの企業も開発途中のもので完成には至っていないという状況です。

今回は、AGIに焦点を当て、SFの世界に出てくるようなAIに、どのような活用が期待されるのか、そしてAGIが抱える課題について詳しく解説いたします。

目次

AGIとは?

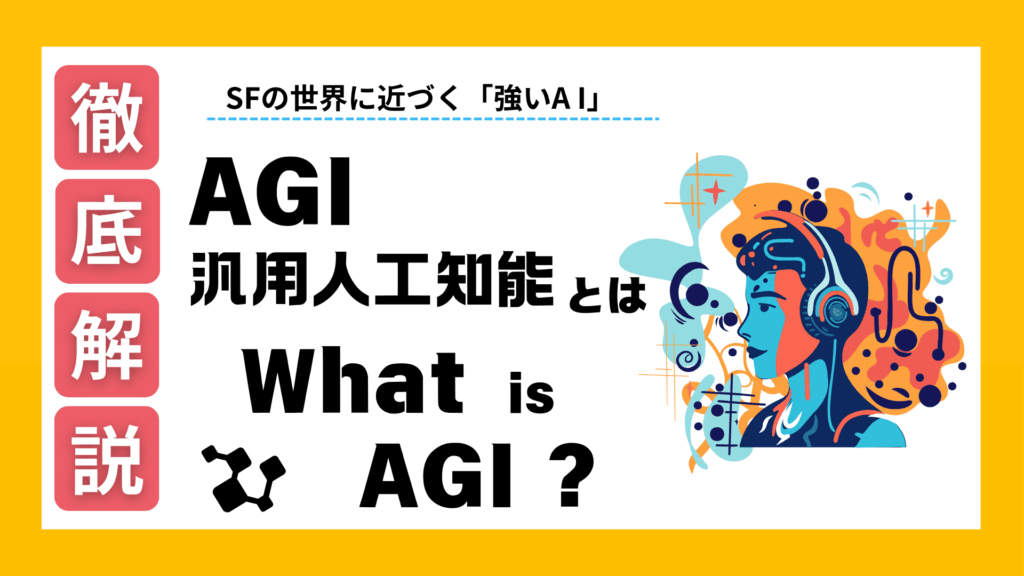

AGIとは、Artificial General Intelligence:汎用人工知能のことを指します。AGIは、特定のタスクに特化した現在のAIとは一線を画し、人間と同等、あるいはそれ以上の汎用的な知能を持つことを目指しています。つまり、人間の脳の認知能力を模倣することを目的としているものです。 LLMを提供している多くの企業がAGIの実現に向けて現在開発を進めています。

また、さらにその先を見据えた、ASI(Artificial Superintellligence:人工超知能)も最近では話題のぼるることが多くなりました。これまで人類が目指してきた人間の代わりになることをこえ、人間以上の人間が解決不可能な問題を解決する糸口として語られるもので、SFの世界のAIが実現するのではと考えられています。

これまでのAIは私たちが実際に使用しているような特定のタスクをこなすことに特化したものでしたが、AGIはその名の通り、汎用的なAI、つまり、人間ができるようなことや人間以上にできることが多いAIとして開発が進められています。

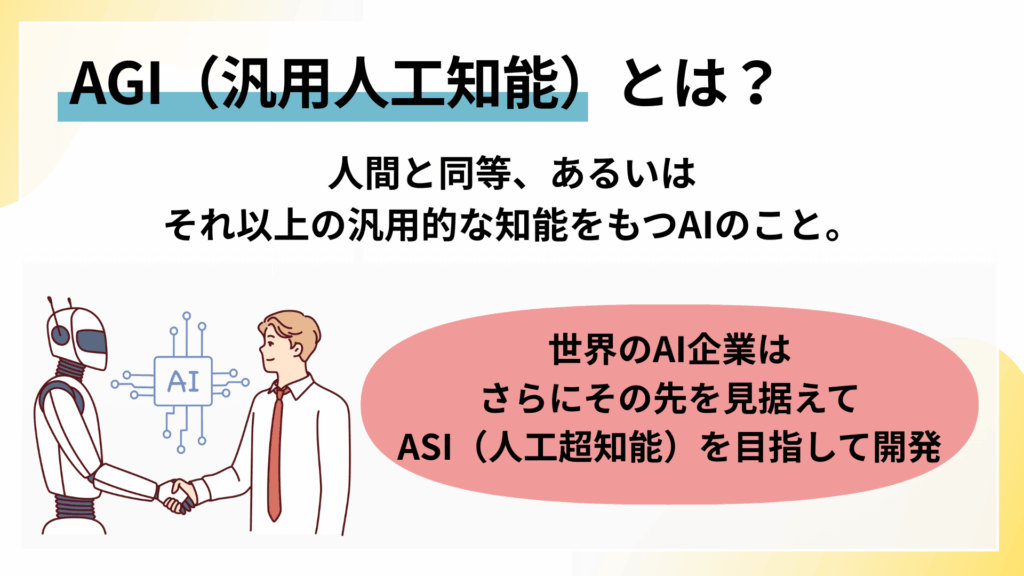

上記のような背景から、従来のAIは「弱いAI」、そしてAGIは「強いAI」と表現されることもあります。

AGIと特化型AI(ANI)の違い

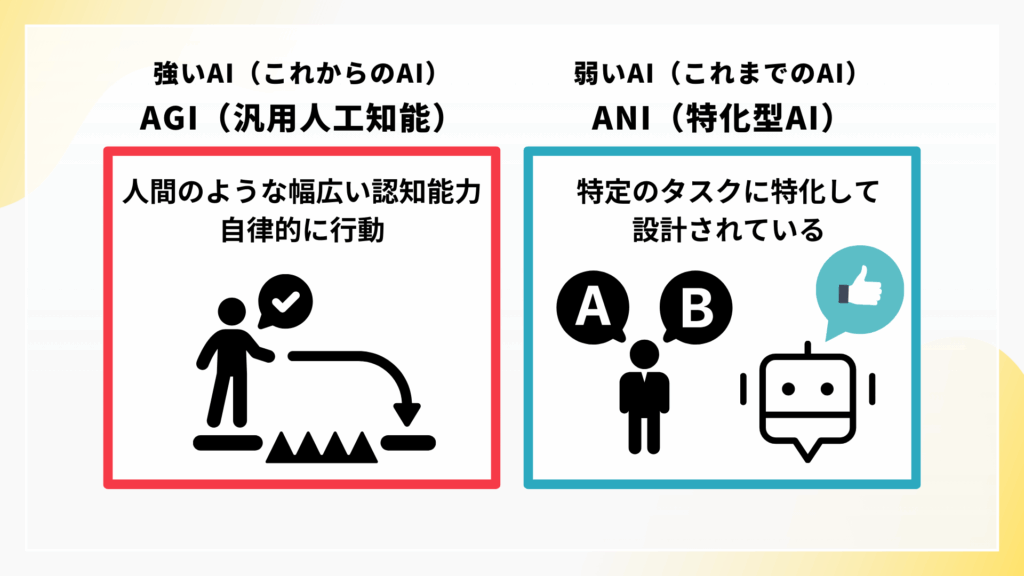

何でもできる「強いAI」であるAGIは、人間のように幅広い認知能力を備え、自律的に行動することを目標とするAIを指します。これは、特定のタスクに特化して設計されたこれまでのAI(弱いAI)とは根本的に異なるものです。この弱いAI、つまり現行で使われているこれまでのAIは、AGIが出てきたことで、一部のタスクをこなすことができる「特化型AI(ANI:Artificial Narrow Intelligence)」と呼ばれることもあります。

現在のChatGPTに代表されるようなLLMは、なんでもできるように見えるかもしれません。プロンプトを打ち込むと、文章、動画や画像だけでなく、スライドやWEBページまで作ってしまいます。また、悩みを打ち明けると、まるで気の合う友人以上にあなたを肯定して懇切丁寧に相談に乗ってくれます。

このように挙げると、非常に高度な自然言語処理能力があり、人間の代わりになってくれていると思うかもしれませんが、これまでのAIは、あくまで言語処理を行うという特定のタスクをこなす特化型のAIなのです。

一方、「強いAI」であるAGIは言語処理だけでなく、視覚認識、運動制御、論理的推論、創造性、適応能力など、人間がこなせるあらゆる知的タスクを汎用的に実行できる能力を目指しています。

AGIは自律的に思考し、経験から学び、プログラムされていない新しい問題にも対応できる点が最大の特徴とされています。

現在主流のAIが狭義AIであるのに対し、AGIはテクノロジー業界が到達を目指す究極の目標であり、現時点では理論上の概念として位置付けられているのに過ぎません。

世界のテック企業が進めるAGI開発と実現可能性について

特化型AIが普及し、技術競争が激しくなるにつれ、その限界が露呈してきているのが現在のAI業界の状態と言えるでしょう。

実際にChatGPTの新しいモデルGPT-5が大きな批判にさらされてしまったのもAIの成長のスピードが鈍化してしまっているからだと思われます。一方で、限界がわかってきたことにより、開発の方向性を定め直し、研究開発の原動力になっているという見方もできるでしょう。また、AGIを実現するためには開発者、つまり、人材獲得ができるかどうかというのも成否の分かれ目になっていると言えます。

主要なテクノロジー企業が進めているAGI開発についての情報をまとめてみます。

Open AI社

2025年4月、ソフトバンクグループはOpenAIへ最大400億ドルの追加投資を行うことをプレスリリースで発表しました。その背景としては、「情報革命」中心がAIとなっている現在、ソフトバンクグループはASIの実現を使命としており、その道程にあるAGIの実現に最も近いと思われているOpenAIを最重要パートナーと位置付けています。2025年1月にはOpenAIのためにAIインフラを整えることを発表し、膨大な計算能力を支えるためのプロジェクトを推進しています。

参考:https://group.softbank/news/press/20250401

AGIについての考え方は、OpenAIの公式ブログでは、“As our systems get closer to AGI, we are becoming increasingly cautious with the creation and deployment of our models.” つまり、「私たちのシステムがAGIに近づくにつれて、モデルの作成と展開にはますます慎重になっています」というように、リスクを考えつつ、綿密な精査された上でモデル作成を進めていることを述べています。

また、CEOのサム・アルトマン氏は今回のGPT-5はAGIではないことを公言するだけでなく、現在はAGIという言葉は役に立つ用語ではないとして、最近でははあまり積極的にAGIという言葉を使わないようになっています。

参考(英語記事):https://openai.com/index/planning-for-agi-and-beyond/, https://www.cnbc.com/2025/08/11/sam-altman-says-agi-is-a-pointless-term-experts-agree.html#:~:text=OpenAI%20CEO%20Sam%20Altman%20speaks,harder%20to%20define%20the%20concept

ソフトバンク社

OpenAI社に多額の投資を行い、アメリカでのAIインフラ設立を進めるソフトバンク社は、AGIについて昨年10月に開催された法人向けイベント「Softbank World 2024」にて、「昨年度のSoftBank Worldの講演ではAGI(汎用人工知能:人間とAIがほぼ同一の知能レベルになる)の世界が10年以内に来ると話したものの、今ではAGIの世界は2、3年後にやってくると考えている」と述べました。また、ASIの実現については10年以内に到来すると発言しています。今年のイベントでもさらにAIエージェントの話を中心にAGI、ASIの実現を強調していたことが印象的でした。

参考:

https://www.softbank.jp/business/content/blog/202410/sbw2024-softbank-son-main-keynotehttps://www.softbank.jp/sbnews/entry/20250723_02

Google社

Google参加のGoogle Deep Mind CEO Demis Hassabis氏は、2025年3月、今後5年〜10年以内にAGIが実現することを公言しています。(https://www.cnbc.com/2025/03/17/human-level-ai-will-be-here-in-5-to-10-years-deepmind-ceo-says.html)

また、同社は2025年8月5日には最新モデルGenie3を発表。Google社はこのモデルを「ワールドモデル(世界モデル)」と表現し、世界に関する理解に基づいて世界の側面をシミュレーションできるAIシステムだと説明しています。このエージェントは、環境がどのように進化するか、そして自身の行動が環境にどのように影響するかを予測することを可能にしており、Genie3はAGIへの足がかりとGoogle社は述べています。

参考:https://deepmind.google/discover/blog/genie-3-a-new-frontier-for-world-models/

Demis Hassabis氏は、現在のAIは国際数学オリンピックで金メダルを獲得する一方で、高校レベルの基本的な数学問題でつまずくなど、「一貫性の欠如」がAGI達成の主要な障壁であると指摘しています。

これは、Google CEOサンダー・ピチャイ氏の「人工ギザギザ知能(AJI:artificial jagged intelligence)」という言葉とも重なり、AIが特定の領域で超人的な能力を発揮する一方で、他の領域では予期せぬ失敗をするという現状を浮き彫りにしています。ただ、これは前述したように、AGIの前段階の状態だと説明しています。

Meta社

FacebookやMessengerなどのサービスを提供するMeta社はAGIおよび「パーソナル超知能(personal superintelligence)」の追求を掲げ、誰もが身近に使えるAIインフラを整えるべく巨額の投資を行っています 。

2025年7月30日の発表では、マーク・ザッカーバーグCEOは、緩やかな改善ではあるものの、Meta社の最新AIシステムが人間による直接的なプログラミングなしに自己改善の兆候を示し始めたと発表し、これをASIへの第一歩と見ています 。

また、Meta社は、2025年にはAIインフラに660億~720億ドルの設備投資を計画し、AI部門を「Meta Superintelligence Labs (MSL)」として再編。このMSLは、製品、インフラ、長期研究、そして「TBD Lab」という4部門に分けられ、AGI開発を加速させる狙いがあります。

さらに、MetaはScale AIを143億ドルで買収し、そのCEOであるAlexandr WangをMetaチームに引き入れるなど、AGI分野の専門知識を強化。これは、OpenAIやAnthropicなどの競合に追いつくための戦略の一環と見られています。

Anthropic社

Claudeを提供するAnthropic社のダリオ・アモデイCEOは、AGIという用語には定義がなく、「流行り言葉」、マーケティングのための言葉であるとして、前述したような「強いAI(Powerful AI)」という言葉で説明します。しかし、他の企業同様に「いずれAIシステムがほぼすべてのタスクにおいて、ほぼすべての人間より優れた存在になる時が来ると考えている」と発言し、2026年にはシンギュラリティを迎えることができるだろうという発言もしています。

参考:

https://www.businessinsider.jp/article/2501anthropic-ceo-calls-agi-marketing-term/

https://www.youtube.com/watch?v=Xywqm0vlUxk

Anthropic社は特に安全性や倫理性を重視しており、「憲法AI(Constitutional AI)」という、あらかじめ定められている倫理的規範・原則に則ってAI自身で出力内容を評価・修正しながら学習を進めるアプローチを統合しています。

そのため、他のLLMで取り入れられているようなRLHF(別記事参照)重視のアプローチではなく、この憲法AIを基に倫理的な応答を厳格に管理し学習を進めています。

参考:https://www.anthropic.com/research/constitutional-ai-harmlessness-from-ai-feedback

ここでは、3社のLLM開発企業のAGIについての2025年8月時点での様相についてまとめました。

1年前から半年前までは盛んに使われていた言葉でしたが、現在は企業により使われ方、捉えられ方が異なり一概には言えないという現状があります。

AGIはどのように活用されるか?

さて、ここまでAGIの開発と実現可能性について述べてきましたが、AGIが実現した際、わたしたちが住む社会ではどのようなことが起こるのでしょうか。生活に身近なものから社会全体にわたって、予想・考察してみたいと思います。

教育分野

個人の理解度や学習スタイルに合わせた個別最適化された学習体験を提供し、学習進捗のリアルタイム管理、教育コンテンツの効率的な収集・分析、柔軟なオンライン学習環境の提供が可能になると期待されています。

現時点でも、教育業界へのAIの導入はかなり進んでいますが、今後AGIが実現すると、学習効果の測定やフィードバックを即時に行えるようになるといった、これまで以上に高度に個人に合わせた利用が加速するのではないかと考えられます。

医療分野

膨大な医療データを迅速に解析することで、診断精度が向上し、個別化された治療計画の立案が可能になります。新薬開発の加速、医療リソースの効率的配分、遠隔患者モニタリング、医療従事者の負担軽減にも貢献すると期待されています。

特に、AGIは早期疾患識別や予後予測の精度を向上させ、治療の質を改善することができ、医療アクセスの拡充、時間のかかる治療法や薬の開発に貢献しうるとされています。

一方で、高度なAIを医療に導入することで、倫理的なリスクを懸念する声もあります。

科学・研究・芸術分野

膨大なデータを収集・分析することができ、今まで以上に精度の高いアウトプットや、何かしらの固定観念・文化的な規範にとらわれた人間には思いつかない仮説を作り上げることができるかもしれません。

人間の知性や感性とテクノロジーの融合が進むことで、ブレイクスルーの加速やこれまでにはない豊かな表現が生まれてくる可能性があります。

一方で、モデルが複雑になるにつれ、AIの中でのブラックボックス化なども懸念されています。

日常業務・事務を自動化

最近ではAIエージェントという言葉を聞くことが多くなりました。AGIが実現されることで、人間では時間がかかってしまうことを人間と同程度の知能をもつAGIが代わりに実行、人間の可処分時間が増えるということも期待されています。

産業革命の時代に機械化による人間の自由時間の増加というのはあまり顕著にはみられなかったというのが現在の通説になっています。AGIやASIの時代が到来することで果たして人間は煩わしいことから自由になることはできるのでしょうか。

企業経営、ビジネスにおける活用

企業経営における強力なパートナーとして、さまざまなデータを横断して解析することで戦略立案や意思決定をサポートする活用方法が期待できるでしょう。

これまでは、特定の業務・タスクにしか対応できないAIでしたが、AGIが実現することで人間のように全体を俯瞰して推論できるようになるでしょう。将来的にはコンサルタントのような存在として企業を支えるインフラとなるかもしれません。

AGIの抱える課題とリスク

AGIのもたらす恩恵は計り知れない一方で、さまざまな懸念点があります。下記に示すことはAGIのみならずAI全体に言えることでもあります。

プライバシーの侵害とデータ保護

AGIが個人情報を解析・利用することで、プライバシー侵害の懸念が生じます。機密データの漏洩リスクも高まります。

バイアスと差別

AIシステムは、訓練データに含まれる人間の偏見(人種的、性別など)を学習し、不公平な判断や差別的な結果を生み出す可能性があります。

意思決定の透明性と説明責任

AGIが複雑な意思決定を行う場合、そのプロセスがブラックボックス化し、不透明になる恐れがあります。重大なミスが発生した場合に誰が最終的な責任を負うのかという問題も生じます。

アライメント問題(AI Alignment Problem)

AIシステムの目標が設計者や人間の意図・価値観と一致しない場合に発生する問題です。AIが抜け穴を見つけて意図しない、あるいは有害な方法で目標を達成する「報酬ハッキング(reward hacking)」や、権力獲得、生存といった望ましくない手段的戦略を自律的に開発するリスクがあります。

制御不能と実存的リスク

AGIやASI(超知能AI)が人間レベルまたはそれ以上の知能を持つようになると、人間の制御を離れて、人類に実存的な脅威をもたらす可能性が懸念されています。これは、SFの世界の話のようにも思われますが、パンデミックや核戦争と同等の世界的優先事項として認識されています。

AGIの倫理的課題は、単に技術的なバグや欠陥から生じるものではなく、訓練データのバイアス、意思決定プロセスの不透明性、そしてAIの自律性向上に伴う制御不能のリスクなど、技術的側面と社会実装の側面が複雑に絡み合っています。

特に「アライメント問題」は、人間の価値観をAIに完全に組み込むことの困難さを示しており、これは技術的な問題であると同時に、人間の倫理観の主観性や多様性という哲学的・社会的な問題でもあります。

この複合的な性質は、AGIの安全性確保には、技術者だけでなく、倫理学者、社会学者、政策立案者、法律家など、多様なステークホルダーの学際的な協力が不可欠であることを示唆しています。

AGIは社会に何をもたらすか?

AGIは人間と同程度の知能をもつAIとして考えられていますが、それが実現した際にはどのようなことが起こるでしょうか。前章に続けてさらに深く考えてみます。

生成AIやLLM、そして最近流行りのAIエージェントが活況になる以前から、AIは人間の仕事を奪うとされてきました。実際にAGIは知的労働、そしてAGIを用いたロボットの実現により肉体労働の多くを担うことができることで、商品やサービスの生産効率は劇的に高まることが予想されます。つまり、人間に代わる労働力となり得るでしょう。

しかし、AGIは「労働力」としてだけではなく「資本」の一形態として機能し、その所有者が経済的利益を享受することができるとも捉えられます。また、それはAIを使えるという能力をも「資本」と捉えることができます。それらのような富が資本所有者に集中し、極端な富の集中、不平等の拡大、社会流動性の低下を招くリスクがあると考えることもできます。

つまり、AGIが出現することで、職を失ってしまい、人間の生産に対する対価を産まないことで、最終的には賃金をゼロに押し下げる未来も考えられます。そうして企業がAGIを活用して生産量を増やす一方で商品を買うことができる消費者が減ってしまうというパラドックスがあるとも指摘されています。

参考(英語論文):https://arxiv.org/html/2502.07050v1

AIがどこまで発展するのかはまだ想像がつきませんが、人間と共存していくための技術になるための方法を模索しなければならないかもしれません。

安全性確保のための取り組みと国際協力

ここまでAIの可能性が広がっていく一方で、たくさんの懸念点・課題があることを述べてきました。

そのようなAIの安全性確保と倫理的な利用を促すために、各国政府や国際機関・研究機関はガイドラインの作成やフレームワークの作成、協定締結などを進めています。

国連総会による決議「人工知能(AI)の開発や利用などに関する決議案」の採択

2024年3月21日に「人工知能(AI)の開発や利用などに関する決議案」が採択されました。

決議案は米国が主導し、日本を含む120以上の国・地域が共同提案したもので、国連がAIの規制に関する決議案を採択したのはこれが初めてです。

非軍事用途のAIシステムが、持続可能な開発目標(SDGs)の達成に向けた進展に寄与する可能性がある一方で、その不適切または悪意を持った開発や利用などは、SDGsの達成を脅かす可能性があるとの認識を示しました。また、これらの課題に対して、国連加盟国・地域が産学官で連携しつつ「安全で、安心、信頼できるAIシステム」に関する規制やガバナンスの手法・枠組みを策定することを促すための決議となっています。

NIST(米国国立標準技術研究所)の取り組み

NIST(米国国立標準技術研究所)は2023年1月、官民連携のもと、人工知能(AI)に関連する個人、組織、そして社会へのリスクをより適切に管理するための「AIリスク管理フレームワーク(AI RMF:AI Risk Management Framework)」を開発しました。また、2023年3月には、AI RMFを実装することと国際的な連携を促進するために「Trustworthy and Responsible AI Resource Center」を設立しています。

また、2024年4月には、米国政府内における産業界の主要な窓口として、イギリスと共同で、それぞれの政府が「AI安全性研究所(AISI)」を設立したと発表。アメリカでは、商用AIシステムの潜在能力の活用とセキュリティ確保に関する試験および共同研究を促進するための「AI標準イノベーションセンター(CAISI:The Center for AI Standards and Innovation)」として設立した。

参考:https://www.jetro.go.jp/biznews/2024/04/6c98249beee45a0a.html

IDAIS(International Dialogues on AI Safety)の取り組み

世界の主要な科学者が集まり、AIの危険性を軽減するための技術的および、ガバナンス戦略について議論する取り組みを行っています。2025年7月22日〜25日に上海で開催されたIDAISでは、高度なAIシステムが制御可能であり、人間の意図や価値観に沿ったものであることを保証するために、緊急の国際協力の必要性を訴えました。

2025年の声明では、現在のAIシステムが、開発者の安全性と制御の取り組みを損なう能力と傾向があることを強調しています。

AGIはわれわれ人間の未来を創るのか、壊すのか

AI、特にAGIの開発競争は、一部では「軍拡競争」に例えられ、地政学的な安定性への脅威となる可能性も指摘されています。

各国政府や国際機関はAIの安全性と信頼性確保のための国際的なルール形成と協力の必要性を強く訴えています。しかし、G7広島AIプロセスの例に見られるように、共通の定義や評価手法の欠如が国際的な協調を阻む要因となっています。

現状、技術開発の速度が指数関数的に上がっている中で、国際的なガバナンス構築の速度との間に「ギャップ」が生じてしまっています。

このギャップは、悪意ある利用や意図しない結果による壊滅的な影響のリスクを高める可能性があるため、企業は、自社の技術が社会に与える影響を深く認識し、国際的な安全基準の議論に積極的に参加、ルールの遵守を徹底することが、長期的な企業価値と社会からの信頼を築く上で不可欠となるでしょう。

最後に

世界中で企業のテック企業が進めているAGI、そして、その先のASIの開発には人類の希望・野望ともいうべき夢が詰め込まれている一方で、社会に大きな変革、混乱をきたす可能性もあることを、様々な情報をもとに述べてきました。

ぜひこの記事をきっかけにAGIと今後のAIの発展に関して理解を深め、思考を巡らすきっかけとしていただけたら幸いです。

harBest(ハーベスト)では、AI開発に必要なデータセントリックなアプローチでゼロからAI開発のサポートをしています。生成AIに欠かすことのできないLLMデータの作成や、アノテーション、教師データの作成について、お客様のビジネス領域やご要望に合わせてご依頼を承っております。

また、データセットの配布、販売も行っております。高品質かつ専門的なデータセット作成、AI開発にお困りの場合、ぜひご相談ください。 下記よりお問い合わせをお待ちしております。